Zur kulturwissenschaftlichen Fundierung der von der EU-Kommision vorgelegten ökonomisch-technologischen KI-Strategie

Ich wurde eingeladen, die Strategie der EU-Kommission zu kommentieren, ich halte es aber für ausgesprochen unhöflich, im Anschluss an die Verkündung großräumige Kritik vorzunehmen. So ein Programm braucht einen großen Resonanzraum. (Das Dokument der Kommission habe ich hier abgelegt.)

Für mich als politisch denkenden Menschen mit Beruf „Digital Manager“ ist das Programm gut nachvollziehbar – und was mir gut gefällt ist, dass es einen Rahmen beschreibt, ein Framework von Ressourcen, Prozessen und Knowhow. Auch wenn ich das Programm im Großen und Ganzen für gut halte, fällt doch auf, dass es – von der technischen Innovation kommend – in ökonomischen Kategorien gedacht ist, sodann flankiert von ethischen und politisch-regulatorischen Fragen. So, wie technische und soziale Co-Evolution eben verläuft: erst kommen Technik und Verwertung, dann muss man sich um Folgen kümmern. Und so geht eben jede Regierung an Probleme heran: sie regelt etwas anders als sich selbst.

Das ist nicht schlimm, aber man kann auch den Blick auf das geistige Fundament richten:

welche Vorstellungen liegen „unter“ oder „hinter“ der KI und welche könnten europäisch sein?

Und man kann auch fragen: Was könnte denn die Politik mit KI zu tun haben, wenn sie also auch auf sich selbst und nicht nur auf die anderen guckt?

These 1: Wir brauchen eine Aufklärung der KI

Die grundlegende, häufig stillschweigend mitlaufende Annahme der KI-Forschung kommt aus dem Big Data-Gedanken, es bräuchte mehr Daten und mehr Rechenleistung, um die bestehende (granulare) Wirklichkeit zu erkennen. Die KI fügt dem noch einen weiteren Gedanken hinzu: etwas von außen muss innen abgebildet werden, und zwar möglichst schnell, vollständig und präzise in seinen Mustern, seiner Struktur. Ein Versuchsaufbau, nennen wir ihn „System“, lernt durch Impulse von außen.

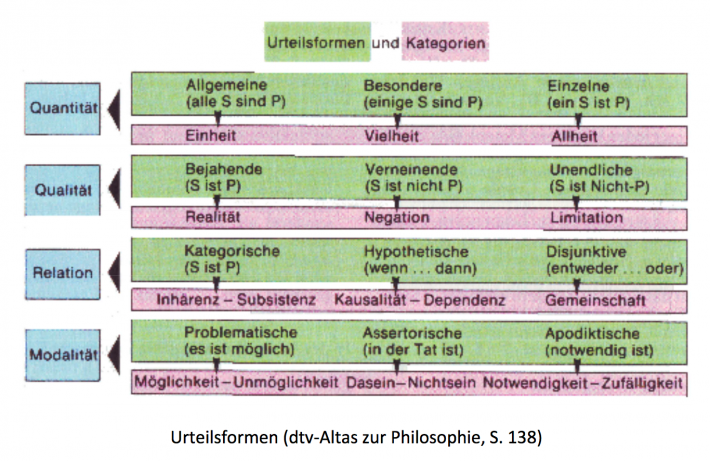

Aber was für eine Art von Erkenntnis ist das, wenn man Datenmuster lernen lässt? Drehen wir die Perspektive einmal komplett um und fragen: Wie muss der Erkenntnisapparat beschaffen sein, um die Wirklichkeit zu erkennen? Das ist die Frage von Kant, auf KI gewendet: Wie muss der Erkenntnisapparat von „Deep Learning“ beschaffen sein, um die Wirklichkeit zu erkennen? Sein Verdienst, kurz gesagt: Die Erkenntnistheorie anders zu denken als bisher. Vor Kant war das Ziel: alle Kraft darauf zu richten die Wirklichkeit da draußen, Gottes Schöpfung, zu erkennen und anschließend zu preisen. Seit Kant aber ist anerkannt, dass der Verstand schon Grundstrukturen mitbringt, und so die Welt für uns erschafft. Aus zwei Beobachtungen, „Der Stein ist warm“ und „Die Sonne scheint“ schließen wir auf Kausalität, unabhängig von der Reihenfolge unserer Warnehmung. Für KI-Forschung hieße das, diese kantianische Wende zu vollziehen, und sich von der Abbildung des Gegebenen hin zu den Strukturierungsmöglichkeiten des Erkenntnisapparates (also: Algorithmus) zu wenden. Eine entwickelte KI kann Ursache von Wirkung unterscheiden, Vorher von Nachher, Selbst und Umwelt und kennt zum Beispiel die Kategorie der Möglichkeit. Eine wirklich europäische Sicht auf KI muss hier ein Schwerpunkt setzen, also mehr bei der Philosophie, z.B. der Bewusstseinsphilosophie, und der Kognitionswissenschaft. Wenn irgendwo, dann wird an diesen Verstandes-Strukturen Intelligenz geboren und nicht mit einem religiösen Schöpfungsakt der Singularisten, der von heute auf morgen die Maschine quasi überfällt.

Warum ist das so wichtig? KI wird erst wirklich eine neue Qualität erreichen, wenn sie ihre Netzwerke nicht mehr als lernende Black Box denkt, sondern irgendwie zu Erkenntniskategorien kommt, die zu einer frühen Stufe von Bewusstheit gehören. Andererseits können diese Geisteswissenschaften vielen Menschen die Angst vor KI nehmen, wenn sie einmal begriffen haben, was für ein Wunderwerk jeder einzelne Mensch überhaupt ist. Mag sein, dass KI irgendwann Subjekte erzeugt. Noch wahrscheinlicher ist, dass der Mensch sich als Subjekt neu entdeckt. Das ist auch die beste Therapie gegen Maschinenangst.

These 2: Wir brauchen eine KI der Vielfalt

Was Europa ausmacht, ist Vielfalt in Einheit. Könnte eine europäische KI nicht irgendetwas mit Vielfalt zu tun haben? Auf den ersten Blick scheint das abwegig. Denn der Kern von KI, jedenfalls nach dem heutigen konnektionistischen Paradigma, ist ein bestimmtes Set an Lernverfahren, die völlig unabhängig von konkreten Sachverhalten in der Realität angewendet werden können. Eine spezifisch europäische KI müsste wohl irgendwie verfahrensmäßig anders lernen als eine nicht-europäische KI, und das ist ja nun wirklich nicht der Fall: Machine Learning ist Machine Learning, wie das kleine Einmaleins das kleine Einmaleins ist, überall auf der Welt – und wie universelle, logische Schlussverfahren, die in Mailand genauso gelten wie in Honolulu.

Auf den zweiten Blick scheint KI die Vielfalt mit gleichen Verfahren dennoch abzubilden: Wo KI auf unterschiedliche Sachverhalte stößt, kann sie diese zu unterscheiden lernen. Bilderkennung in Berlin wird die Spreewaldgurke gut erkennen, in Baden-Württemberg die Wurstvielfalt und in Italien die Pasta-Vielfalt. Es entsteht eine spanische KI, eine italienische KI, eine deutsche KI. Und wenn eines Tages, das wird noch lange hin sein, Software-Agenten miteinander verhandeln, dann tun sie das vielleicht mit lokalen Temperamenten. Aber nicht das KI-Verfahren ist landesspezifisch, sondern nur seine Eingaben und Ausgaben. Es gilt saxonian in, saxonian out, oder – weniger fremdenfeindlich – bayerisch in, bayerisch out.

Trotzdem werden ökonomische Grenzen und digitale Kopien dazu führen, dass die Vielfalt unter die Räder kommt. Dialekte sind ja schon heute bei der Sprachausgabe verschwunden, oder maschinenlesbare Ontologien enthalten den „Berliner Schlüssel“ nicht, mit denen Bruno Latour noch seine bahnbrechende ANT-Theorie so gern erklärt hat. Auch die Notwendigkeit von globalem Austausch und Maschinenlesbarkeit macht das Plattdeutsch platt.

Kulturen würden also noch gleichförmiger werden, KI kennt dann alle Räume, alle Würste, alle Pasta. Kopien vermehren immer mehr vom Selben, bis am Ende alles überall ist. Daher sollte eine europäische KI-Politik darauf achtgeben, dass regionale Kultur-Differenzen nicht verschwinden. Ich will damit aber gar nicht das große Fass der „Identitätspolitik“ aufmachen, mir geht es nur darum, dass kein technosozialer Sog entsteht, alles zu vereinheitlichen. Das Starren auf den „Algorithmus“ führt ohnehin in die Irre: In Wirklichkeit bedeutet KI irgendwann Vielfalt, weil sie die Komplexität der Außenwelt nach innen „faltet“, in sich selbst, ein „Selbst“, das so verschieden wie die Außenwelten ist. Die Bedingung dafür ist aber, dass man sie mit derartigen Daten füttert, sonst geschieht das nicht.

Von der Vielfalt ist es nicht weit zu einer „pluralistische KI“. Es ist keine gute Nachricht, aber sie ist wahr: Diskriminierung ist Unterscheidung und dies ist geradezu die Kernkompetenz von KI, die mal „feuert“ und mal nicht (und übrigens auch die Kernkompetenz des Menschen, der sein Bewusstsein auf ein Etwas richtet, und somit in diesem Aufmerksamkeitsakt von anderem unterscheidet). Es werden nacheinander zwei Selektionen getroffen: erst wählt der Mensch das Datenset, dann macht der Algorithmus (besser: das neuronale Netz) eine Selektion. Die Maschine wird immer besser als der Mensch unterscheiden können, sie kann größere Datenvolumina in Echtzeit analysieren – Computer sind also die besten Diskriminierungsmaschinen überhaupt.[1] Wenn man diskriminierungsfreie oder eine ganz weit formuliert „neutrale“ oder „unverzerrende“ (unbiased) KI will, müsste man einen Weg finden, wie Maschinen das zuvor ersichtlich Ungleiche dann doch gleichbehandeln. Dabei geht es nicht um die objektive Gleichheit, sondern um die Umsetzung von Gleichbehandlung trotz Verschiedenheit, also ein normatives Anliegen. Um zu dieser Gleichbehandlung zu kommen, nehmen wir Menschen eine Analogie vor, sie ist – in einer Formulierung von Douglas Hofstadter gesagt – das „Herz des menschlichen Denkens“. Der „richtige Analogieschluss“ gehört zu den höchsten Leistungen menschlichen Denkens. Maschinen können das auf absehbare Zeit nicht, denn sie müssten dafür ein Drittes benennen und begründen, warum die Analogie berechtigt ist. Daher werden Maschinen auf sehr lange Zeit bei Schritt 1, der Unterscheidung (=Diskriminierung) stecken bleiben.

Doch zurück zu Europa: Meiner Meinung nach könnte die Forderung nach einer pluralistischen KI die Probleme einer verzerrenden KI heilen – nicht bei Kreditvergaben, wohl aber in anderen Anwendungsfeldern der KI, vor allem bei Medien. Man könnte sogar KI-Schöpfungen entwickeln, die absichtlich verschieden sind. Lassen Sie uns doch das Problem zur Lösung machen: Es gibt für Nutzer verschiedene Algorithmen zur Auswahl. So haben wir uns ja auch mit Massenmedien arrangiert: kaum eines ist „neutral“ und es gibt mehrere davon. Enzensberger schreibt schon 1970 im Kursbuch:

„Ein unmanipuliertes Schreiben, Filmen und Senden gibt es nicht. … Ein revolutionärer Entwurf muß nicht die Manipulateure zum Verschwinden bringen; er hat im Gegenteil einen jeden zum Manipulateur zu machen.“

Um Vielfalt und Pluralität als „europäisches Gen“ im Spielfeld der KI zu entwickeln, ist eine inhaltliche Aufgabe für die Kulturwissenschaften. Auch hier braucht Europa sie bei einer KI-Strategie.

These 3: KI des Sozialen

Meine dritte These ist im Grunde eine Wette, denn ich kann die Zukunft nicht voraussagen. Meine These ist: Wir können mit KI die Gesellschaft besser verstehen lernen. Es gibt jetzt schon viele Datenpunkte, und mit den großen Plattformen sind soziale Infrastrukturen entstanden, welche die Gesellschaft in ihren Strukturen sichtbarer machen.

Wer nun sagt: das hatten wir alles schon und das ist doch gescheitert, der hat nicht Unrecht. Die Soziokybernetik und die Politische Kybernetik, die in den 1940ern begannen, verstanden den Staat als ein beständig lernendes, informationsverarbeitendes Feedbacksystem, das seine eigenen Strukturen fortwährend an wechselnde Umweltbedingungen anpasst, um ein einmal gesetztes Ziel auch dann zu erreichen, wenn der Weg dorthin ungewiss ist. Diese Kybernetik verglühte in den 1970ern leise, und das zu Recht: zu simpel und technokratisch, von rationaler Kälte, war die Idee, man könnte Gesellschaft mit ein paar PCs in Regelkreisen abbilden und steuern. Auch die Namen sind mitverglüht: Wer kennt heute noch Karl W. Deutsch, Karl Steinbuch (damals als Buchautor berühmt), Georg Klaus im Osten (mit Blick auf die Steuerbarkeit einer sozialistischen Zentralwirtschaft)? In linken Nischen hat Stafford Beer ein bisschen Kultstatus erlangt, der mit Cybersyn in Chile mit Fernschreibern landesweit Produktionsanlagen steuerte.

Einige ihrer Grundgedanken sind aber heute wieder höchst aktuell, z.B. wenn es um Selbstorganisation, Lernen und Flexibilität geht – die heutigen Diskussionen um „agile“, „liquide“, „adaptive“ Organisationen setzen darauf auf. Man darf nur mit heutigem Kenntnisstand nicht den großen Steuermann (Kybernetes) herbeisehnen. Denn weder lässt sich einfach steuern, noch kann die Komplexität einer ganzen Gesellschaft modelliert werden – man denke etwa an das berühmte world3 des Club Of Rome, in Javascript zu bewundern hier – aus der System Dynamics, die heute eher kleinere soziale Gebilde als die ganze Welt erforscht. Man würde heute statt von Steuerung eher von Transparenz und Nachvollziehbarkeit von sozialer Selbstorganisation sprechen – und das nicht auf einer Makro-Ebene, sondern eher einer Meso-Ebene: nicht der ganzen Gesellschaft, sondern z.B. Städten, um urbane Wanderungen zu verstehen, vielleicht um spezifische Konflikte in bestimmten geographischen Lagen zu analysieren, und natürlich Frühwarnsysteme für Hungersnöte oder Umweltkatastrophen zu erkennen, auch für deren Ursachen (Materialermüdung etc). Diese mittlere Ebene war ja schon der Beobachtungsgegenstand berühmter Soziologen, nur eben noch nicht digital: Levi-Strauss in Brasilien, Simmel in Großstädten, Foucault in Gefängnissen und Kliniken. Soziologische Großtheorien wie die Theorie sozialer Systeme sind ja eher die Ausnahme.

Den Bedarf zeigt seit Jahren schon der Datenjournalismus (z.B. das Stimmungsbarometer bei ZEIT Online), allerdings noch KI-frei.

Und jetzt kommt die Überraschung: genau das macht die Computational Social Science, eine interdisziplinäre Verbindung aus Informatik und Soziologie (sie ist leider gerade durch Cambridge Analytica (genauer: den Wissenschaftler Kogan, der den Nutzungsvertrag gebrochen hat) etwas in Verruf geraten). Sie beobachtet zum Beispiel die Ausbreitung von News, Verbindungen von Menschen, Verhaltensänderungen wie Wahlquoten, Kommunikationsmuster von Mails – sie ist ganz klar die Wissenschaft der Zukunft, wenn es um Fake News und dergleichen geht, und damit ist die Computational Social Science auch eine Grundlagenwissenschaft für demokratische Öffentlichkeit. Sie kann darüber hinaus Wissen an die Politik liefern.

Fazit

Drei Beispiele haben gezeigt, wie wichtig Kulturwissenschaften sind (also Geistes- und Sozialwissenschaften). Die allfällige Forderung nach „KI-Ethik“ leistet das nicht, obwohl Ethik natürlich auch in die Strategie eingebettet werden muss.[2] Diese Wissenschaften sind auch Teil eines interdisziplinären Forschungsansatzes, der die KI schon immer geprägt hat, beispielsweise die „theory of mind“. Man kann die Befruchtungen und Übergänge auch gut an der Frame-Theorie sehen, die heute in Massenmedien wieder entdeckt wird: sie hat Wurzeln in der Philosophie (Kant, siehe oben 1.), findet sich in der Semantik wieder, wurde in den 70ern von der symbolischen KI (Minsky) aufgenommen, wird in der Kognitionswissenschaft behandelt) und ich fand sie in der deutschen Soziologie bei Esser.

In Anlehnung an Odo Marquardt ließe sich sagen: Wir brauchen diese Wissenschaften, um das Neue zu reflektieren und uns wiederzufinden. Er hat einmal gesagt:

„Die Geisteswissenschaften helfen den Traditionen, damit die Menschen die Modernisierung aushalten können; sie sind […] nicht modernisierungsfeindlich, sondern – als Kompensation der Modernisierungsschäden – gerade modernisierungsermöglichend. Dafür brauchen sie die Kunst der Wiedervertrautmachung fremd gewordener Herkunftswelten.“[3]

Daher gehören Geistes- und Sozialwissenschaften zu einer europäischen KI-Strategie dazu und brauchen einen festen Platz dort und ebenso institutionelle Unterstützung und Förderung.

Fussnoten:

- Um es nach dem Kybernetiker Gregory Bateson zu formulieren: Wenn ein Unterschied einen Unterschied macht, dann geschieht das im Computer, der einen anderen informatorischen Zustand einnimmt. ↑

- Der allfällige Ruf der politischen Öffentlichkeit nach einer „KI-Ethik“ ist berechtigt, doch vor allem vom Wunsch nach Sicherheit und Regeln getrieben und wird in der Praxis von Güterabwägungen und Interessenskonflikten geprägt. Mit einer inhaltlichen Fundierung von KI hat er wenig zu tun und läuft auch Gefahr, entweder an Komplexität oder an Banalitäten zu scheitern („do no harm“). ↑

- Interessanterweise stammt dieses berühmte Zitat aus einer Zeit, in der sich die Geisteswissenschaften gegen die Naturwissenschaften behaupten mussten, siehe den Briefwechsel hier ↑

Ein Kommentar zu

“Anmerkungen zur KI-Strategie Europas”